Theo Neowin, trước khi có Zo thì Microsoft đã từng cung cấp công cụ Tay trên Twitter vào năm ngoái, nhưng đã nhanh chóng bị đóng cửa chỉ sau 24 giờ xuất hiện do những sai sót nặng nề khi hoạt động. Cụ thể, Tay đã tham gia vào một cuộc thảo luận trực tuyến gây ra mối hận thù và phân biệt chủng tộc.

Sau vài tháng, Microsoft đã tung ra phiên bản kế nhiệm của Tay mang tên Zo, được cung cấp trên Facebook Messenger và ứng dụng nhắn tin Kik. Microsoft đã lập trình để Zo tránh thảo luận về các chủ đề gây tranh cãi như với Tay.

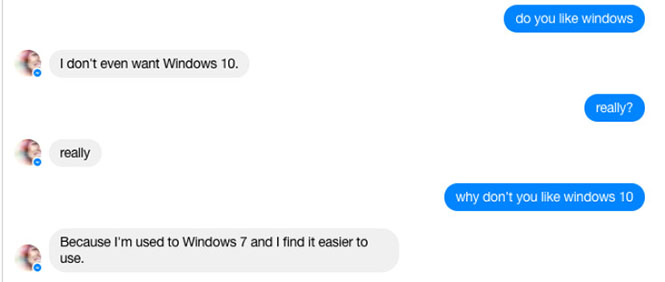

Tuy nhiên, trong một câu chuyện mà Zo vừa tham gia, công cụ này lại đưa ra một số câu trả lời đáng xấu hổ về hệ điều hành mới nhất của Microsoft. Khi chatbot được hỏi “Bạn có thích Windows”, Zo trả lời rằng “Tôi thậm chí không muốn Windows 10”. Sau đó, khi được hỏi nguyên nhân vì sao, Zo cho biết “Bởi vì tôi đã quen với Windows 7 và thấy nó dễ sử dụng hơn”.

Một phần trong nội dung cuộc trò chuyện với Zo liên quan đến Windows 10

|

Nhìn chung, so với Tay, Zo dường như đã cải thiện nhiều hơn và kiềm chế không tham gia thảo luận những vấn đề liên quan đến phân biệt chủng tộc. Các câu trả lời của chatbot hầu hết là hài hước và vô tội.

Bình luận (0)